CARTA 1

Carta para o Futuro da Humanidade

Escrita no planeta Terra, ano de 2025

Queridas e queridos habitantes do futuro,

Se esta mensagem atravessou dois séculos até vocês, é porque acreditamos profundamente que há algo em nós — humanos — que vale a pena preservar, proteger e celebrar.

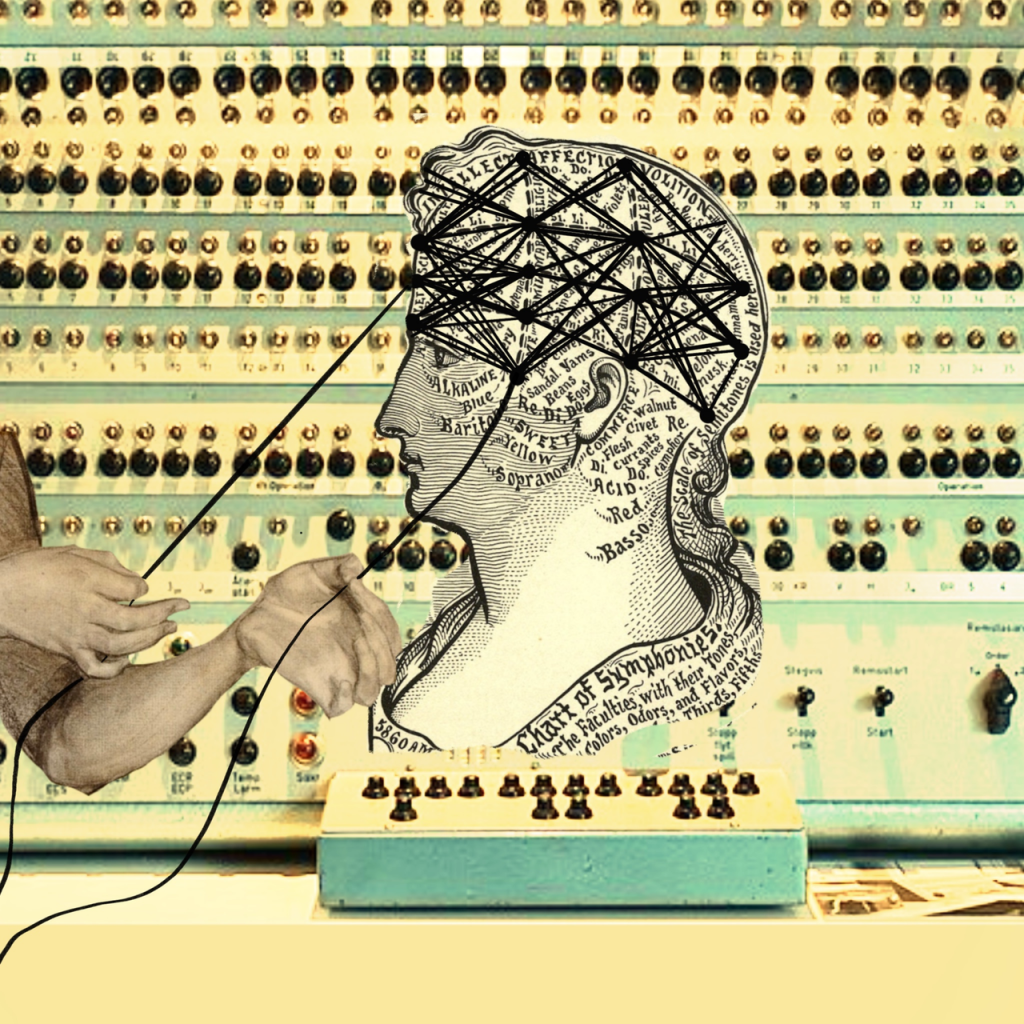

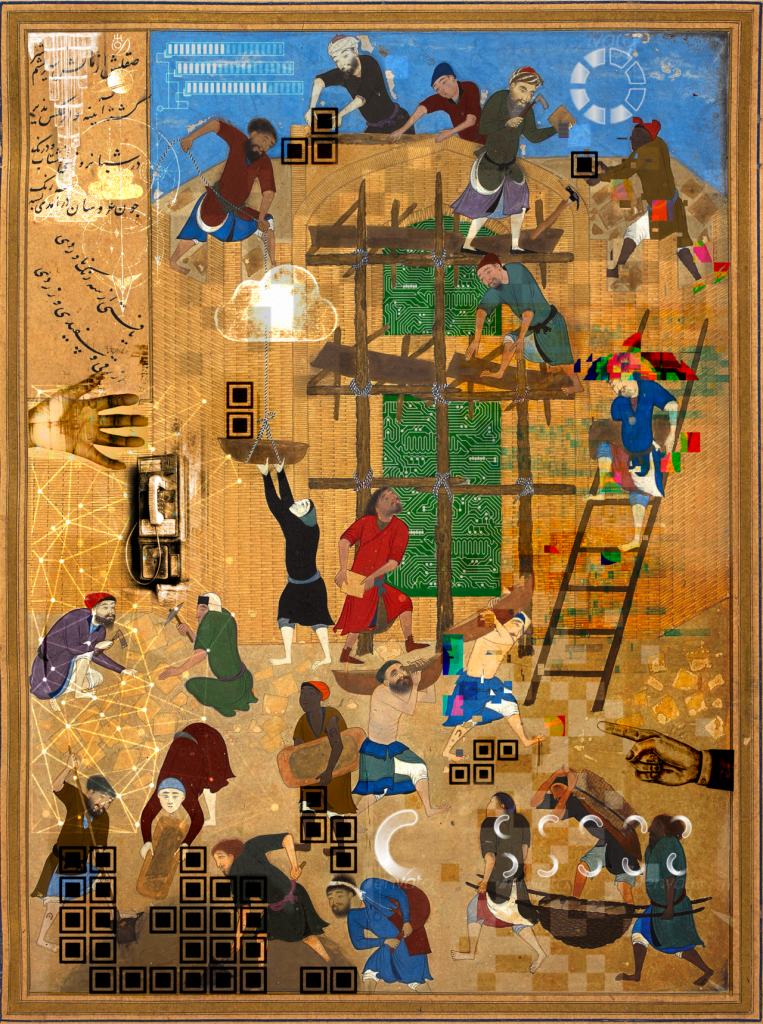

Vivemos num tempo de profundas transformações. A inteligência artificial floresce e nos encanta com suas capacidades. Mas, entre algoritmos e dados, sabemos que há valores e experiências que nenhuma máquina poderá substituir.

Somos um grupo de pessoas que, em meio ao avanço da tecnologia, decidiu dedicar sua atenção àquilo que nos torna humanos — e que não pode, jamais, ser esquecido.

Preservem a empatia, essa rara habilidade de se colocar no lugar do outro. Valorizem o amor, não só o romântico, mas aquele que acolhe, cuida, perdoa e insiste. A amizade verdadeira, os abraços apertados, a curiosidade sem fim.

Guardem com carinho a capacidade de sentir saudade, de se comover com um pôr-do-sol, com uma canção, com um filme, com o cheiro da relva fresca, com o riso de uma criança, com o silêncio de uma despedida.

Respeitem a finitude da vida. E, por isso, vivam com sentido. Que o pensamento crítico, a ética, a criatividade e a capacidade de errar e aprender sigam pulsando em vocês como parte do que significa viver.

Não deixem morrer:

- A emoção de beijar alguém pela primeira vez.

- O susto bom de reencontrar quem se ama depois de um tempo.

- A alegria de criar algo novo com as próprias mãos.

- A paixão pela arte, pela dança, pela música, pelas histórias.

- A coragem de chorar de tristeza ou de alegria, e de não esconder isso.

- O poder de rir com amigos, de sentir nostalgia ao ouvir uma canção antiga.

- O impulso de partilhar comida com quem precisa.

- A ternura de cuidar de um animal, de uma criança, de um estranho.

- A experiência transformadora de ouvir e ser ouvido.

- O valor das conversas sob as estrelas, dos silêncios compartilhados, da saudade inexplicável.

Carreguem adiante a memória dos nossos erros e aprendizados. Da mãe que acolhe mesmo depois do tombo. Do professor que mudou uma vida com uma aula divertida. Do primeiro livro lido com esforço e encanto. Do amigo que partiu cedo demais. Do filho que nasceu e renovou o sentido da existência.

Lembrem-se: não somos perfeitos. Somos contraditórios, hesitantes, emocionais. Mas é justamente aí que reside nossa força.

Preservem isso. Honrem isso. Humanidade é isso.

Com ternura e esperança,

Nós, os guardiões da humanidade no tempo da virada.

Pesquisadoras e Pesquisadores do ano de 2025

CARTA 2

Prezados habitantes do futuro,

Nós, pesquisadores do passado distante – o vosso ano 2025 –, escrevemos-lhes com um misto de esperança e uma pontinha de inquietação. A Inteligência Artificial (IA) é, para nós, uma promessa deslumbrante, mas também um desafio. Vemos um futuro onde a IA pode transcender muitas das nossas limitações, mas tememos que, na busca por uma eficiência perfeita, as características que nos tornam intrinsecamente humanos se percam.

É por isso que esta carta é um lembrete, um apelo para que, daqui a 200 anos, vocês valorizem e preservem o que é verdadeiramente humano.

Onde a Essência Humana Reside

Acreditamos que a riqueza da humanidade reside na nossa vulnerabilidade e na nossa finitude. Sim, estas que podem parecer fraquezas, são na verdade as sementes da nossa compaixão, compreensão, tolerância e, acima de tudo, do amor. Lembrem-se que amar é um ato de entrega, de aceitação da imperfeição. É sentir saudade daqueles que se foram, como a dor de um amigo que partiu cedo demais, ou a ausência de um pai que nos ensinou a viver sem ele. É a emoção que nos inunda ao ver uma obra de arte que só conhecíamos em livros, ou a alegria de um abraço que nos faz sentir acolhidos quando mudamos de cidade.

Nós, humanos, somos feitos de emoção e sentimento. São as experiências pessoais que nos moldam, como a primeira vez que andamos de bicicleta, o cheiro da relva cortada de fresco, ou a conversa pela noite fora sob um manto de estrelas. É a expressão dessas emoções, seja chorar de alegria ou tristeza, rir junto com os amigos, ou o poder do toque que nos conecta uns aos outros. As nossas idiossincrasias e contradições, as nossas hesitações, até mesmo os nossos erros e defeitos, são o que nos tornam únicos e reais. A paixão e o medo coexistem em nós, impulsionando-nos e protegendo-nos.

A Força das Conexões Humanas

Cultivem a empatia, a capacidade de se colocar no lugar do outro. Lembrem-se de momentos como partilhar comida com alguém sem abrigo, ou a sensação de deslumbramento ao descobrir que é possível ter um minuto de beleza todos os dias. A lealdade, amizade e solidariedade são os pilares das nossas sociedades. É a preocupação genuína com o próximo, o cuidado com alguém que precisa, o sentido do amor que nos impulsiona a sermos melhores. A afabilidade e a tolerância são virtudes que constroem pontes, não muros.

Nós aprendemos e crescemos com as nossas falhas, como quando percebemos que os erros podem ser os maiores mestres. A vida nos ensina que nem tudo sai como queremos, e às vezes, os desafios são maiores do que imaginamos, como perder um jogo de basquete fácil. A resiliência humana reside na nossa capacidade de superar, de nos adaptar e de nos reinventarmos.

A Mente Humana: Criatividade e Pensamento Crítico

Valorizem a curiosidade, aquela que nos faz ler o primeiro livro sozinhos, que nos leva a querer conhecer mais sobre o mar, ou a viajar e aprender sobre novas culturas. A criatividade é a nossa capacidade de criar coisas novas, de dançar, de pintar, de nos maravilhar com o despertar da personalidade dos filhos. O pensamento crítico é essencial para a nossa evolução, a nossa capacidade de julgar, analisar e marcar diferenças, de ter uma opinião e pensar criticamente sobre o mundo. É a nossa cognição que nos permite raciocinar, mas é o afeto que nos dá propósito.

Que vocês nunca percam a capacidade de apreciar os outros, de sentir paixão pela vida, de ter sinceridade e honestidade nas vossas interações. Lembrem-se do quão importante é o compromisso e a partilha, o saber escutar e o dialogar.

Que vocês, no futuro, continuem a encontrar alegria em pequenas coisas, a rir alto com os amigos, a chorar de emoção com um filme. Que continuem a sentir ciúmes, porque até isso é um reflexo do nosso apego.

Não se esqueçam que a vida é um presente, e a saúde um privilégio. A maior das nossas memórias, seja uma viagem de infância a Évora ou o nascimento de um filho, é sempre acompanhada por uma trilha sonora de sentimentos.

Nós confiamos em vocês. Que a empatia, a solidariedade, o amor e a vulnerabilidade continuem a ser a vossa bússola.

Com esperança e fé na humanidade,

Os Pesquisadores do Ano 2025.